CEO Nvidia: Nhu cầu tài nguyên tính toán đang tăng phi mã

CEO Nvidia Jensen Huang cảnh báo rằng nhu cầu tài nguyên tính toán toàn cầu đang tăng theo cấp số nhân, khi cuộc đua phát triển trí tuệ nhân tạo (AI) bước vào giai đoạn khốc liệt nhất từ trước tới nay.

Phát biểu tại một sự kiện Điện tử Tiêu dùng (CES) tại Las Vegas, vị tỷ phú công nghệ nhấn mạnh các doanh nghiệp đang cố gắng chinh phục biên giới công nghệ mới. Điều này kéo theo cơn khát khổng lồ với phần cứng tính toán, đặc biệt là các bộ xử lý đồ họa (GPU).

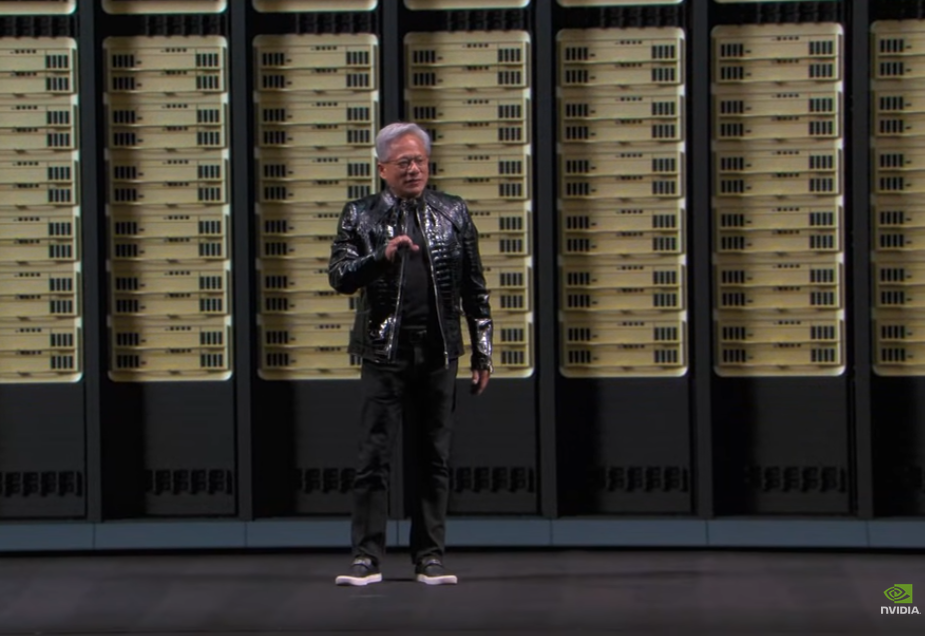

CEO Nvidia Jensen Huang tại Sự kiện Điện tử Tiêu dùng (CES) tổ chức tại Las Vegas (Ảnh: Nvidia)

Nhìn lại quá trình phát triển của AI, tỷ phú Jensen Huang nhận định mọi công ty đều đang cố giành vị trí dẫn đầu ở thế hệ tiếp theo của công nghệ.

“Càng có nhiều năng lực tính toán, các công ty càng có cơ hội sớm đạt được bước đột phá tiếp theo”, CEO Nvidia nói, đồng thời cho rằng tốc độ xử lý đang trở thành lợi thế cạnh tranh cốt lõi trong ngành AI.

Ông cho biết các mô hình AI hiện nay ngày càng lớn và phức tạp, với quy mô tăng gấp khoảng 10 lần mỗi năm. Điều đó đồng nghĩa với việc lượng tài nguyên máy tính cần thiết để huấn luyện và vận hành các mô hình này cũng tăng theo cấp số nhân.

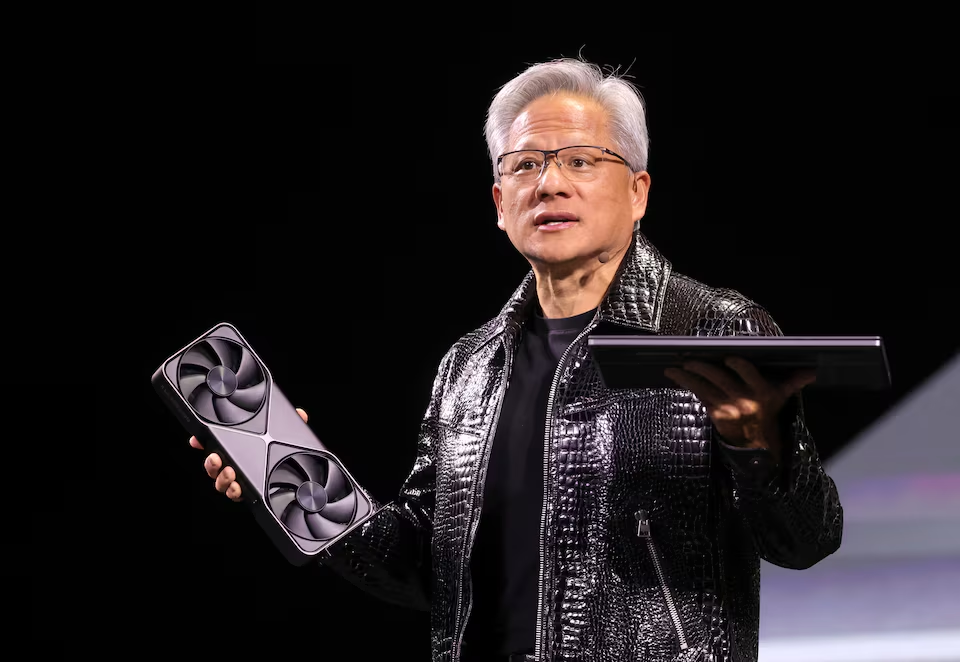

Nvidia tung thế hệ chip mới, hiệu năng AI tăng gấp 5 lần

Cũng tại sự kiện này, tỷ phú Jensen Huang cho biết dòng chip thế hệ mới Rubin và Vera của Nvidia đã bước vào giai đoạn sản xuất và đang triển khai đúng kế hoạch.

Theo Nvidia, khi kết hợp với nhau, Rubin và Vera có thể mang lại hiệu năng xử lý AI cao hơn khoảng 5 lần so với các thế hệ trước. Đây được xem là nền tảng để Nvidia tiếp tục đáp ứng nhu cầu tính toán ngày càng lớn của thị trường trong những năm tới.

Thông tin này được đưa ra trong bối cảnh Nvidia đang chịu áp lực cạnh tranh ngày càng lớn, không chỉ từ các đối thủ truyền thống như AMD, mà còn từ chính các khách hàng lớn như Google, những công ty đang tự phát triển chip AI riêng.

Nvidia tung thế hệ chip mới, hiệu năng AI tăng gấp 5 lần (Ảnh: Nvidia)

Theo chia sẻ, các hệ thống Vera Rubin có thể được kết nối thành những “cụm” (pods) với hơn 1.000 chip, giúp tăng hiệu quả tạo “token” – đơn vị cơ bản trong vận hành AI – lên gấp 10 lần. Đây là yếu tố then chốt quyết định tốc độ phản hồi và chi phí vận hành của chatbot.

Để đạt được bước nhảy vọt về hiệu năng, Nvidia cho biết chip Rubin sử dụng một dạng dữ liệu độc quyền, và hãng kỳ vọng tiêu chuẩn này sẽ được ngành công nghiệp chấp nhận rộng rãi.

CoreWeave sẽ là một trong những doanh nghiệp đầu tiên triển khai hệ thống Vera Rubin.

Dù vẫn thống trị mảng huấn luyện mô hình AI, Nvidia đang đối mặt với cạnh tranh khốc liệt hơn ở khâu triển khai AI tới hàng trăm triệu người dùng cuối.

Áp lực mới với ngành "đào coin"

Sự gia tăng nhu cầu tính toán cho AI đang tạo ra những hệ lụy lan tỏa sang lĩnh vực khác, trong đó có ngành khai thác Bitcoin.

Trong vài năm trở lại đây, nhiều công ty "đào coin" đã chuyển hướng, sử dụng một phần hạ tầng để phục vụ các dịch vụ tính toán cho AI. Nguyên nhân đến từ việc độ khó đào Bitcoin ngày càng cao, trong khi lợi nhuận biến động mạnh.

AI, ngược lại, mang lại nguồn thu ổn định hơn, giúp các doanh nghiệp tối ưu hóa hệ thống máy chủ và trung tâm dữ liệu vốn đã đầu tư.

Nếu nhu cầu AI tiếp tục tăng như dự báo của Nvidia, xu hướng “rời đào coin, sang bán năng lực tính toán” có thể còn lan rộng./.